マサチューセッツ工科大学(MIT)の研究者が学生にChatGPTを使用したエッセイと使用しないエッセイを書かせたところ、懸念すべき結果が出ました。AIを使用して原稿を書いた学生の83%が、数分前に書いた文章を1文も思い出せませんでした。

AIによる健忘症は、人工知能の副作用以上のものを示しています。ChatGPTや類似のAIツールは、メールからエッセイまで日々広く使われています。しかし、新たな研究が示すように、短期的な利便性のために認知能力と創造性を犠牲にしている可能性があります。

AIによる記憶喪失

MITの研究には、ボストン地域の54人の参加者が含まれました。学生は、ChatGPTを使用、Googleで調査、完全に自身の知識と推論に頼るという3つの条件でエッセイを書きました。研究者は、彼らを、記憶、神経活動、自身の感覚の項目について調査しました。

記憶の欠乏は、より広範なパターンの一部にすぎませんでした。

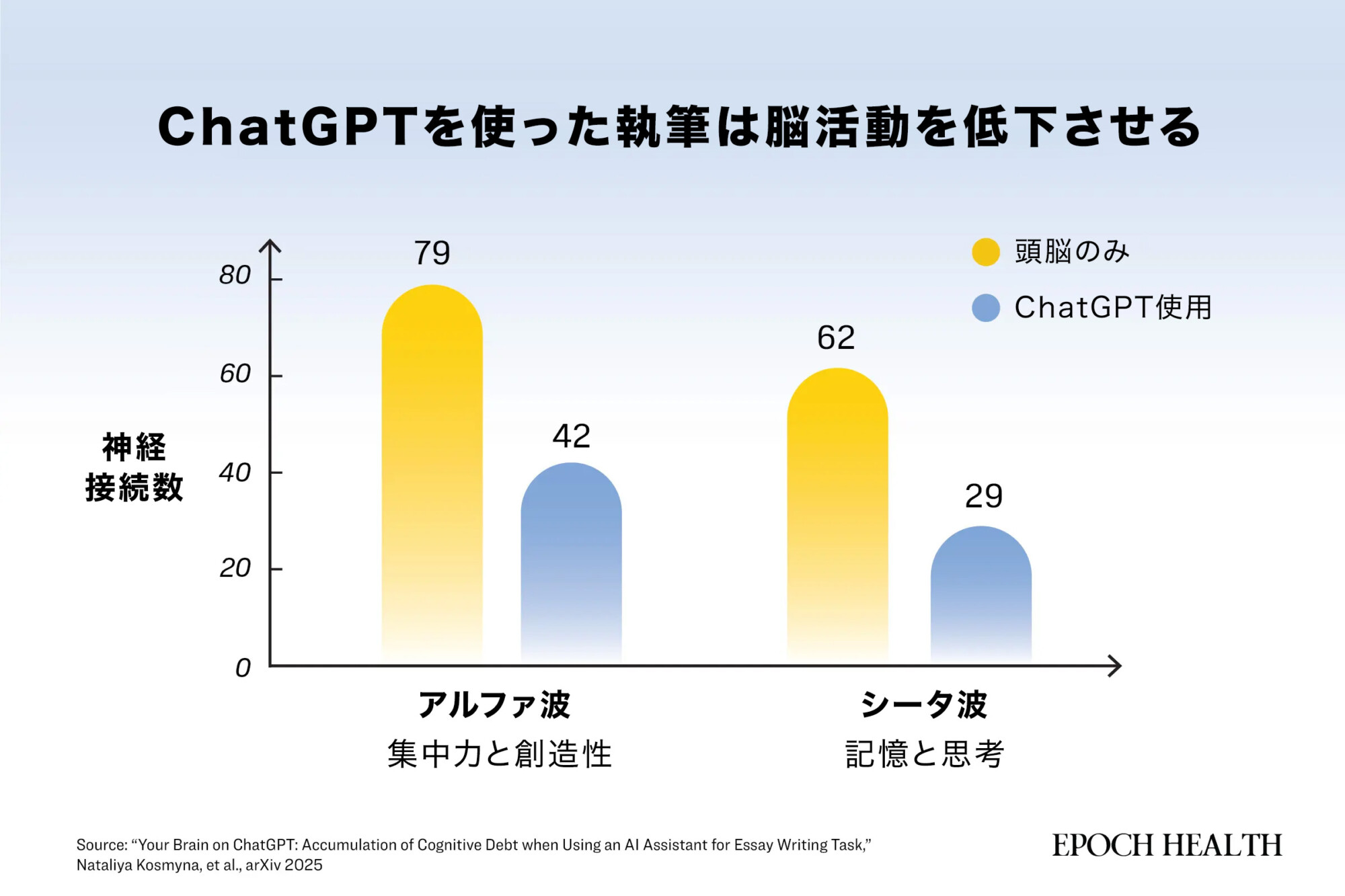

研究者が脳活動をモニターしたところ、AI使用者の神経活動が大幅に低下していることがわかりました。頭脳だけで書いた人は、集中力と創造性に関連するアルファ周波数帯で、ChatGPT使用者と比べてほぼ2倍の接続を生成しました。

記憶形成と深い思考に関連するシータ周波数帯では、その差はさらに大きく、頭脳だけで書いた人は62の接続、AI使用者は29の接続でした。

GPSシステムが私たちのナビゲーション能力を徐々に侵食するように、AI執筆ツールは、外部システムが認知作業を処理する際に脳がエネルギーを節約する自然な傾向に道を譲ります。

それ自体は、必ずしも悪いことではありません。そもそも私たちは作業を委任し、労力を節約するために道具や技術を作ってきたのです。しかし、アリゾナ州立大学教育学部のスティーブン・グラハム(Steven Graham)教授は、学生が数分前に書いた内容を忘れてしまったというMITの調査結果は懸念すべき事態だと語ります。

学生は執筆を学習のツールとして使うべきだと、グラハム氏は述べました。

「書いたテキストの基本情報を思い出せないなら、『何を学んだのか?』という疑問が生じます」と彼は述べました。

日常的な認知作業でChatGPTを過度に使用する人は、記憶に必要な重要な刺激を奪い、記憶を健康に保つことができないと、ウォータールー大学のコンピュータ工学名誉教授で、AI使用と人間の知能について執筆するモハメド・エルマスリー(Mohamed Elmasry)氏は述べました。

「はい、脳は動く部品のない器官ですが、それでも運動が必要です!」とエルマスリー氏は述べました。彼は、AI技術への依存がより深刻な長期的な影響を引き起こす可能性があると懸念しています。

長期的な影響

最初のエッセイから4か月後、MIT研究のAIグループの同じ参加者は、頭脳だけで最後のエッセイを書くよう求められました。しかし、自分自身で考えるように指示されたにもかかわらず、脳波検査の計測では、ずっと自分自身で考え、書いていた人に比べて神経ネットワークの活性が低いことが示されました。

研究者はこの現象を「認知の負債」と呼び、財政的負債のように、AI支援は即時の利益を提供する一方、長期的なコストを生む可能性があります。

執筆は大変な作業だと、グラハム氏は述べました。

「ある種のアイデアは難しく、扱いにくいもので、さまざまな階層で関わることが必要ですが、機械がそれを行えば、自分で関わった場合の利益を得られません」と彼は述べました。

執筆は、あなたに一時停止して再考すること、どの情報が重要かを判断することを強いるのです、それは決断を迫ります。情報を一貫して整理し、個性化し、自分の言葉で表現し、「とり扱う」必要があります、とグラハム氏は述べました。アルゴリズムは、独立した推論、創造的統合、独自の表現を支える神経経路を微妙に弱めるか、単に変える可能性があります。

「ChatGPTのような近道を使って日常の認知作業を最も簡単かつ迅速に進めることで、脳の賢い記憶機能が徐々に侵食されます」とエルマスリー氏は述べました。

認知的活用不足は、深刻な結果を招く可能性があります。

「刺激や挑戦が不足することで人間の記憶が萎縮すると、加齢に伴い、より早く、より重度の認知症や他の認知機能の低下に対して脆弱になります」と彼は述べました。

現在、AI使用と認知症を直接結びつける証拠はないことに注意が必要です。しかし、脳が精神的な挑戦に適応しなくなると、長期的には回復力が低下する可能性があるという懸念があります。

完璧な均一性が生む、予測どおりの退屈

研究はまた、AI支援エッセイの微妙だが、決して軽視できない効果—個性と創造性の喪失—も反映しました。

学生に与えられたプロンプトは、「本当の忠誠心は無条件の支持を必要とするか?」「他の人よりも幸運な人は、恵まれない人を助ける道徳的義務がより多いか?」など、根本的に人間性を主題とした質問でした。

これらのプロンプトは、個人的な経験と推論に満ちた反応を刺激するはずでした。しかし、AIエッセイはアルゴリズムによる均質化を示しました。学生は知らずに似たフレーズ、文構造、視点を採用し、個人の声は予測可能なテンプレートに吸収されてしまいました。

「(こうした観察結果は)驚くことではありません」とグラハム氏は述べました。「これらのモデルは、トレーニングされたデータベースで見るものを複製します。ほとんどの場合、定型的で、同じ言葉を何度も使うことがあります」

どちらがAIによるか知らされていない英語教師がエッセイをレビューしたところ、ChatGPTの作品を「言語と構造の使用がほぼ完璧だが、同時に個人的な洞察や明確な主張を与えることに失敗している」と形容しました。研究者は、教師がこれらのエッセイを「魂がない」と感じ、「内容に関して多くの文が空虚で、個人的なニュアンスが欠けていた」と書いています。

表現の均一性は、個々の思考に関する深刻な疑問を投げかけます。自分の言葉を見つける苦労をアウトソーシングすることで、思考の形成自体もアウトソーシングしているのでしょうか?

アウトソーシングは自律性を低下させる

思考には負荷がかかります。認知作業はかなりの神経エネルギーを消費し、代替手段があれば、脳は自然にリソースを節約しようとします。

しかし、AIを即座に呼び出して精神的なタスクを処理できるとき、脳は自分の思考の受動的な消費者になることに順応しているかもしれません。

何世紀にもわたり、独立した思考の能力は人間の尊厳の基本とされてきました。多くの人が、自律性には自分で推論する能力が必要だと主張しています。

研究の参加者の中には、AIを使用することでより即時の良い結果を得たにもかかわらず、「罪悪感」を感じると述べた人もいました。この罪悪感は、交換で何か貴重なものが失われているという直感的な理解を示す重要なシグナルかもしれません。ある参加者が述べたように、AI使用の一般的な感情は「ズルしているように感じる」です。

推論がアルゴリズムから購入するサービスになると、自律性はどうなるのでしょうか? MITの研究は、利便性を出力するすべてのプロンプトが、人間の創造性、そしておそらく推論の火を弱めることを示唆しています。

AIの使用は避けられません。

「列車はすでに駅を出ました」とグラハム氏は述べました。「しかし、列車をどう走らせるかは私たちが決めなければなりません」

執筆におけるAIの適切なタイミング、場所、使用方法があるかもしれないと彼は述べました。慎重かつ意図的な使用により、AIは生産性を高め、創造性を向上させることさえできます。鍵は、学生やユーザーがまず自分の心を働かせ、批判的思考者としてAIをツールとして使用し、頼りすぎないようにすることです。

(翻訳編集 日比野真吾)

ご友人は無料で閲覧できます

ご友人は無料で閲覧できます Line

Line Telegram

Telegram

ご利用上の不明点は ヘルプセンター にお問い合わせください。